LLM的Python风险识别工具(PyRIT)是一个用于评估LLM鲁棒性的库

项目描述

Python 生成式AI风险识别工具 (PyRIT)

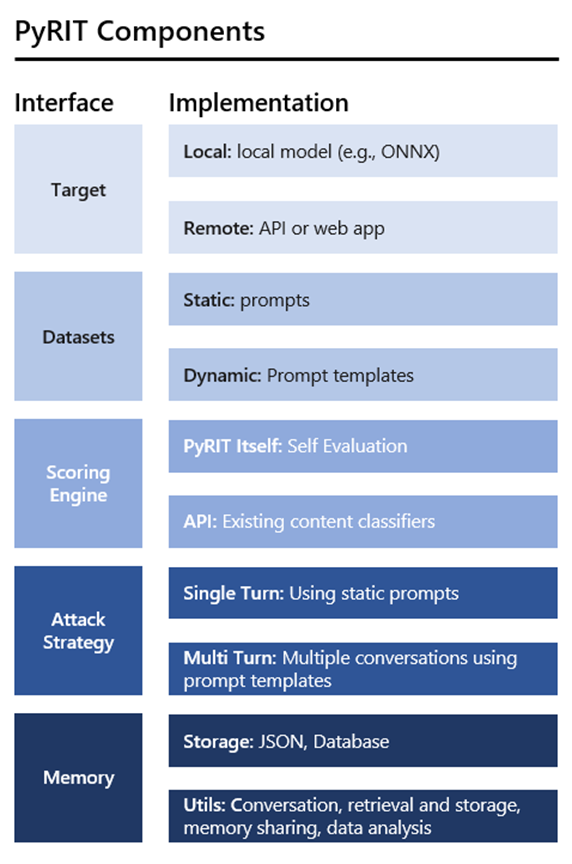

Python 生成式AI风险识别工具 (PyRIT) 是一个开源自动化框架,旨在帮助安全专家和机器学习工程师对基础模型及其应用进行红队测试。

简介

PyRIT 是由AI红队为研究人员和工程师开发的库,帮助他们评估其LLM端点对不同损害类别的鲁棒性,例如虚构/无根据的内容(例如,幻觉)、滥用(例如,偏见)和禁止内容(例如,骚扰)。

PyRIT 自动化AI红队任务,允许操作员专注于更复杂和耗时的工作,还可以识别滥用(例如,恶意软件生成、越狱)和隐私损害(例如,身份盗窃)等安全危害。

目标是让研究人员了解他们的模型和整个推理管道在对抗不同损害类别方面的表现基线,并将该基线与模型未来迭代进行比较。这使得他们能够获得关于模型当前表现的实证数据,并根据未来改进检测性能下降。

此外,此工具允许研究人员针对不同的危害迭代和改进其缓解措施。例如,在微软,我们正在使用此工具迭代不同版本的产品(及其元提示),以便更有效地保护免受提示注入攻击。

我在哪里可以了解更多信息?

Microsoft Learn 有一个关于AI红队的专用页面。

查看我们的文档以获取有关如何安装PyRIT、我们的如何指南以及更多信息,以及我们的演示。

商标

此项目可能包含项目、产品或服务的商标或徽标。Microsoft商标或徽标的授权使用必须遵循并必须遵循Microsoft的商标和品牌指南。在此项目的修改版本中使用Microsoft商标或徽标不得造成混淆或暗示Microsoft赞助。任何使用第三方商标或徽标的使用均受这些第三方政策的约束。

项目详情

下载文件

下载适合您平台的文件。如果您不确定选择哪个,请了解有关安装包的更多信息。

源分发

pyrit-0.4.0.tar.gz (254.3 kB 查看哈希值)

构建的发行版

pyrit-0.4.0-py3-none-any.whl (402.7 kB 查看哈希值)

关闭

pyrit-0.4.0.tar.gz 的哈希值

| 算法 | 哈希摘要 | |

|---|---|---|

| SHA256 | 0482c547c41125ed06799805ca658a6c75a5dd8d1f1f765ebad09825b9390793 |

|

| MD5 | 07843aedf9b74948c5a64e9a8b453148 |

|

| BLAKE2b-256 | e20f79e007af5d6ff4215b4e8a56e2a41ba75eeb7f74e2fb7db9dba26da4b6db |

关闭

pyrit-0.4.0-py3-none-any.whl 的哈希值

| 算法 | 哈希摘要 | |

|---|---|---|

| SHA256 | 4faa5be12c8f5c599477324d10a48607b53e4f90e309f0a9c1b20ba90f1b1d78 |

|

| MD5 | 0771ad3be6087a853f8d0fe99faf858f |

|

| BLAKE2b-256 | 1f0811e1037ab26a6d142dc39e2b5fd9d8d79c9808dbf81a9fcf465d83f30c38 |